记杨强老师关于联邦学习的讲座

5 月 6 日刚从杭州回到武大准备毕业答辩,得知赫赫有名的杨强老师第二天将来武大,介绍他带领的微众银行人工智能团队在联邦学习上的一些工作和思考。我们实验室的研究方向包括迁移学习的应用,而杨强老师是迁移学习领域的领头人,因此一定是要前往聆听的。老师的讲座内容没有很多算法模型上的硬核知识,但也非常有宏观上的启发性。下面,我基于讲座的内容笔记及个人思考做一个整理。

杨强《人工智能,数据孤岛和联邦学习》

目前的 AI 系统在包括有偏性、和人类的合作、可解释性、可靠性、可信性、公平性等方面存在很多问题,其中一些问题的根因是数据的缺失和数据量的不足。杨强老师指出,目前的时代是“数据孤岛时代”,以法律、金融、医疗为首的各行业各公司都只拥有小数据。数据共享是一个容易被想到的解决方案,但其存在难度高、不合规、利益相关等问题,使得不但同一行业不同公司之间难以展开合作,甚至连同一公司各部门之间都存在“数据墙”。

为了解决数据量不足的固有问题,杨强老师在过去的近十年内致力研究大数据迁移到小数据,即迁移学习(Transfer Learning)。因此,杨强老师首先简单回顾了迁移学习,其中有这些结论值得注意:1)迁移学习有助于实现鲁棒性(同样的输入对应同样的输出)和边缘计算(模型的计算放在终端进行)。2)迁移学习的本质是找到不同领域数据的不变量。3)在进行模型迁移时,低层特征更通用和可迁移,高层特征更特定和不可迁移。4)当两个领域相距很远时,可以进行传递性迁移学习([Distant Domain Transfer Learning, AAAI 17], [Transitive Transfer Learning, KDD 15])。

在从学校转投工业界,发现上述工业界亟待解决的问题后,杨强老师提出了联邦学习(Federated Learning)的概念,致力于将拥有细碎数据的各控制方可以参与联合建立 AI 模型,并协作使用模型来进行决策。在这个过程中,各方数据不出本地,因此互相之间看不到彼此的真实数据,不会违反保护个人数据隐私的相关法案,并且能够保证数据的安全和各方的利益。同时,我们力求模型的效果不会受到损失(LOSSLESS)。

联邦学习的一个典型流程是终端本地训练 -> 秘钥加密梯度 -> 上传云端 -> 更新模型。例如,将手机终端存储的特征维度相同的用户数据在本地训练,然后将梯度等信息加密后,上传到唯一的中心,在云端中心用所有终端的信息更新模型后,手机终端再下载更新的模型。这个流程的缺点是过程比较漫长。

除了如上述流程所示的安全模型建立,联邦学习还试图解决很多为了保护用户隐私而导致的问题,例如隐私保护下的样本 ID 匹配,如何能够在各家银行互相不泄露用户信息的前提下,找到同时在多家银行借贷而没有偿还能力的人。

联邦学习的研究子方向包括但不限于:

系统效率

- 模型压缩(Compression)

- 算法优化(Optimization algorithms)

- 参与方选取(Client selection)

- 边缘计算(Resource constraint, IoT, Edge computing)

模型效果

- 数据分布不均匀(Data distribution and selection)

- 个性化(Personalization)

数据安全

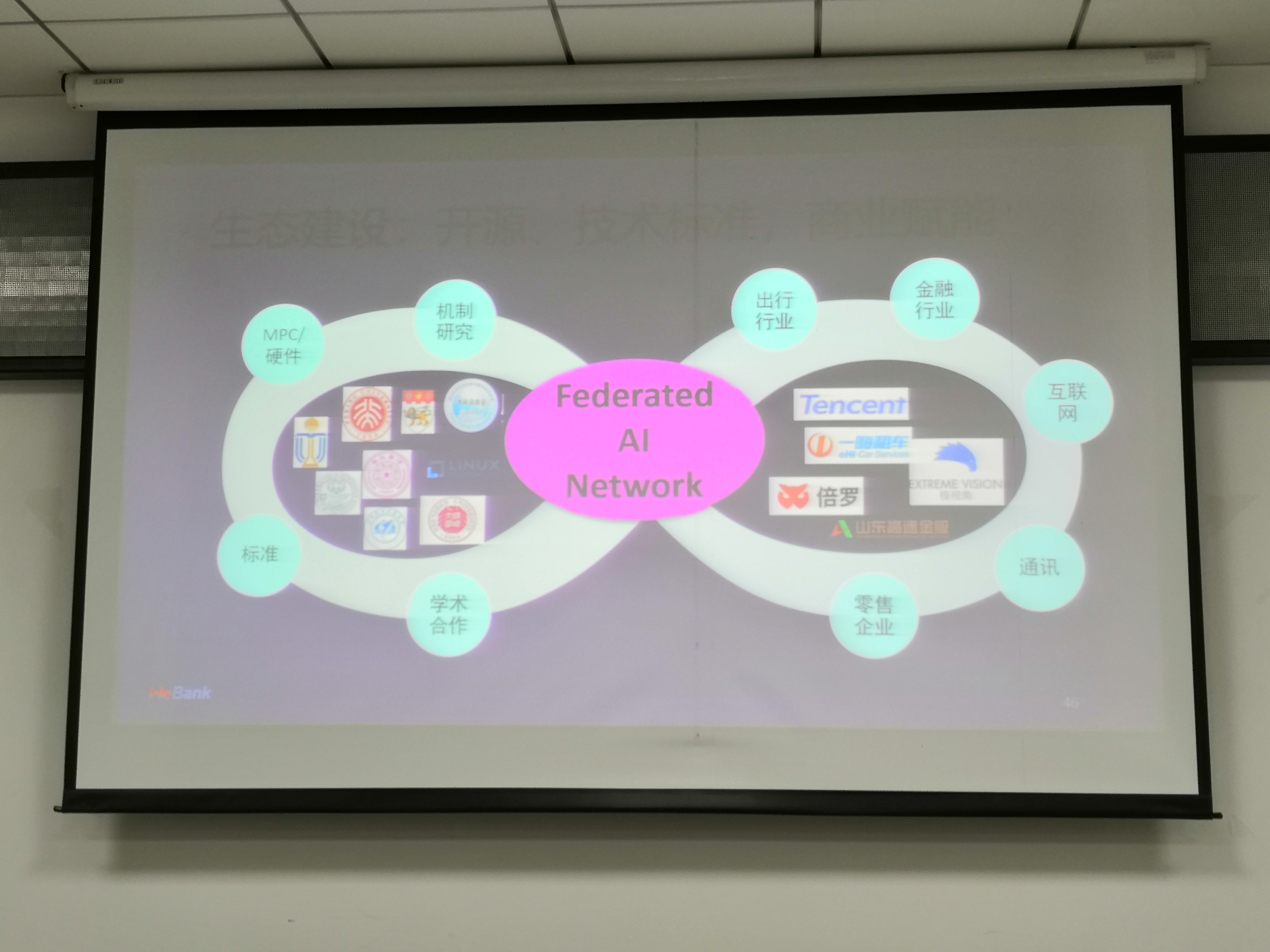

可以看到,作为一个工业界实际需求催生的研究方向,联邦学习所涉及的领域实际上不只有机器学习,还包括密码学、网络安全等。例如,联邦学习联盟的激励机制需要用到博弈论,来讨论各方如何合理分配通过联邦学习共同收获的利益。目前,IEEE 正在建立纵向联邦学习标准,相信也有很多不限于人工智能领域的专家会参与到这个过程中。更多有关联邦学习的内容可以访问 https://www.fedai.org。

以上是我对杨强老师讲座内容的总结。在提问环节,杨强老师对于科研起步者如何入门的问题做了简单解答。他认为,在研究开始时,应该找一个足够窄的领域中的一个足够清晰的问题,在走完一个完整的科研周期后成功发表自己的第一篇论文。他把这个过程比喻为找一个足够弱的敌人,打一场完整的胜仗;之后,就应该开始寻找当研究生毕业时什么领域会热门,而不是盲目投身现在大热的领域。找到未来的热门领域可能很难,需要多和别人交流和分析。在未来热门但现在可能是一片荒地的领域开荒也很难,杨强老师认为需要将在该领域的研究过程划分阶段,在每个小阶段取得成功后,将其变为故事能讲给同行学者、业界专家和普通人群。另外老师提出,能在人工智能行业取得成功的人需要懂人工智能、有商业头脑、有管理能力。